Vivimos una paradoja informativa: nunca tuvimos tanto acceso a voces diversas, y nunca nos sentimos tan encerrados en burbujas emocionales. En ese contexto, los artículos que explican cómo operan los sistemas de recomendación -no solo qué muestran- se vuelven lecturas obligadas para cualquiera que quiera entender la política del siglo XXI.

Transcribimos completo este texto de Marc Torrens y Carlos Carrasco-Farré, publicado en Do Better (Esade), por tres razones:

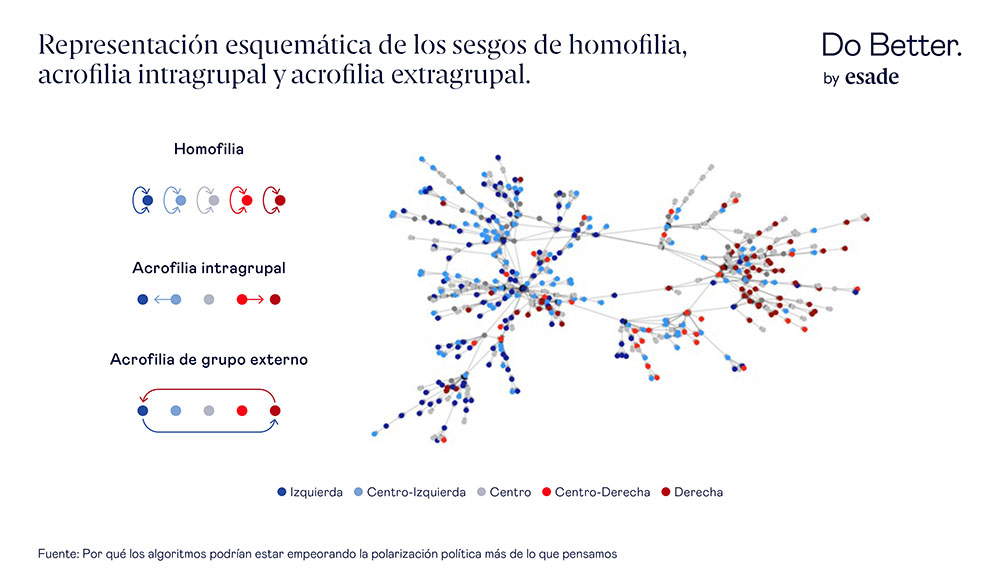

- Claridad conceptual sin renunciar al rigor. Los autores introducen el concepto de acrofilia algorítmica (la tendencia de los sistemas a empujar contenidos más intensos emocionalmente) con una precisión que permite distinguir entre polarización “humana” y polarización “estructurada por diseño”. Esa distinción es clave para no caer en diagnósticos simplistas.

- Evidencia empírica accesible. El estudio citado -más de 300.000 videos, 1,7 millones de enlaces de recomendación- no se queda en la teoría. Muestra dos caminos concretos hacia la distorsión política: el empujón hacia extremos del propio espectro y la exposición desproporcionada a caricaturas del espectro opuesto. Entender esa mecánica es el primer paso para pensar soluciones.

- Relevancia transversal. Aunque el foco es YouTube, la lógica descrita opera en cualquier plataforma que priorice la atención sobre la deliberación.

Si estamos debatiendo cómo auditar ideológicamente a los modelos de lenguaje, este artículo nos recuerda que la pregunta no es solo “¿qué piensa la IA?”, sino “¿qué tipo de conflicto político hace visible, y con qué intensidad emocional?”.

Lo transcribimos íntegro, además, porque en la era del resumen automático, leer completo un análisis bien construido es un acto de resistencia cognitiva. Torrens y Carrasco-Farré no ofrecen recetas mágicas, pero sí un marco para preguntar mejor: ¿qué versiones del desacuerdo estamos aprendiendo a reconocer como “normales”? ¿Y qué versiones del otro estamos siendo entrenados para descartar como “amenazas”?

En un mundo donde cada vez más ciudadanos aprenden qué es la política a través de sistemas diseñados para maximizar la interacción, esa pregunta no es académica. Es democrática.

………………………

Por qué los algoritmos pueden estar agravando la polarización política más de lo que creemos

Imagina abrir tu plataforma online preferida para ver noticias políticas. No estás buscando extremismo. No quieres profundizar en ningún conflicto. Haces clic en un video, luego en otro, después en otro más. Y, poco a poco, el mundo político que se te presenta empieza a cambiar. Tu propio lado político parece más nítido, más seguro, más cargado emocionalmente. El otro lado parece más extremo, más provocador, más amenazante. La plataforma no te ha dicho qué pensar. Pero puede haber cambiado silenciosamente el mapa emocional de la política a tu alrededor.

En otras palabras, los sistemas de recomendación no solo organizan contenidos. Ayudan a organizar la percepción. Además, cada vez es más difícil consumir contenido online que no esté mediado por sistemas de recomendación o algoritmos de personalización. Consumimos lo que los algoritmos filtran y priorizan para nosotros.

Los algoritmos de recomendación influyen en qué voces se perciben como representativas, qué posiciones parecen normales y qué oponentes resultan más visibles. En el ámbito político, esto puede tener consecuencias que van mucho más allá del tiempo de pantalla. Puede moldear cómo los ciudadanos entienden el desacuerdo, cómo escala el conflicto y cómo se vive la democracia en la práctica. En ese sentido, el algoritmo no solo estrecha lo que vemos. También puede estar elevando su intensidad emocional.

Lo que aparece en nuestras pantallas no es una muestra neutral de la vida pública. Es el resultado de decisiones técnicas, comerciales y organizativas sobre qué merece ser amplificado. Y esas decisiones pueden influir en cómo los ciudadanos imaginan a sus oponentes, cómo se percibe el conflicto y cómo se desarrolla el debate democrático. Esto importa porque millones de personas aprenden y se informan sobre política a través de sistemas diseñados principalmente para atraer la atención. Estos algoritmos no están diseñados para maximizar la frecuencia y la duración de la interacción del usuario. Son sistemas impulsados por incentivos económicos.

El profesor asociado del Departamento de Operaciones, Innovación y Data Science de Esade, Marc Torrens, y el profesor de Ciencia de Datos en TBS Education, Carlos Carrasco-Farré, realizaron un estudio en el que analizaron la red de recomendaciones políticas de YouTube utilizando más de 300.000 videos y aproximadamente 1,7 millones de enlaces de recomendación. Su pregunta era sencilla: cuando alguien ve contenido político, ¿qué tipo de contenido le sugiere después la plataforma? La respuesta fue preocupante: los patrones de recomendación pueden favorecer la extremidad ideológica de dos maneras diferentes. Primero, dirigiendo a los usuarios hacia contenido más extremo dentro de su propio espectro político. Segundo, exponiéndolos de forma desproporcionada a contenido extremo del espectro político opuesto. Los resultados de esta investigación han sido publicados en el Journal of Management Information Systems.

El algoritmo no solo nos refleja; estructura cómo se ve el conflicto

La defensa habitual de los sistemas de recomendación es que simplemente reflejan las preferencias de los usuarios. Las personas hacen clic, las plataformas aprenden y el sistema ofrece más de lo que parece interesarles. Pero los hallazgos de Torrens y Carrasco-Farré sugieren que está ocurriendo algo diferente.

La acrofilia comienza como una tendencia social: las personas suelen orientarse hacia expresiones más intensas y emocionalmente resonantes de la identidad de su grupo. Sin embargo, en las plataformas digitales, esa tendencia deja de ser puramente humana. Se organiza, se repite y se amplifica mediante algoritmos. En ese sentido, los sistemas de recomendación no solo reflejan la polarización. Pueden darle forma. Pueden convertir una tendencia psicológica humana en una característica recurrente del entorno informativo.

Esto es especialmente relevante porque un entorno democrático saludable no requiere que todos estén de acuerdo. Pero sí exige que el desacuerdo sea inteligible. Cuando las plataformas muestran repetidamente la versión más emocionalmente explosiva de los oponentes políticos, no están ampliando la comprensión. Están entrenando la atención hacia la confrontación y la polarización.

Dos caminos hacia la polarización, no uno

El primer camino es bastante conocido. Un usuario consume contenido cercano a su visión del mundo y el sistema lo empuja hacia una versión más extrema de esa misma visión. En el estudio, esto se observó claramente en la transición de contenidos de centro-derecha hacia contenidos de derecha más radical. Esto es acrofilia intragrupal: no se trata solo de permanecer entre afines, sino de ser arrastrado hacia los más intensos.

El segundo camino es menos evidente y, posiblemente, más peligroso. El usuario no solo recibe contenido de su propio lado, sino también contenido extremo del lado contrario. No se trata de un desacuerdo moderado ni de una oposición constructiva, sino de la versión más emocional y distante ideológicamente del otro grupo. Ambos investigadores encontraron este patrón tanto en recomendaciones de izquierda a derecha como de derecha a izquierda. Esto es acrofilia extragrupal.

Puede parecer abstracto, pero su implicación cotidiana es clara. Alguien que comienza con contenido moderado puede acabar siendo dirigido hacia las voces más intensas de su propio lado y hacia las más incendiarias del lado opuesto. El resultado es un campo político distorsionado: tus aliados parecen más radicalizados, tus oponentes más exagerados y el centro resulta más difícil de ver. No es solo más información. Es una realidad social distinta.

Pero ¿por qué importa esto? Porque la exposición a la diferencia no es lo mismo que la exposición a la comprensión. Un entorno informativo saludable podría introducir alternativas moderadas, puntos de encuentro inesperados o desacuerdos que inviten a la reflexión. Pero cuando una plataforma muestra sistemáticamente la caricatura más extrema del adversario, puede profundizar la hostilidad en lugar de ampliar la perspectiva. El resultado no es deliberación. Es confrontación optimizada para captar atención.

La emoción como parte del mecanismo

Uno de los hallazgos más llamativos del estudio es que estos patrones de recomendación están estrechamente vinculados a la emoción. El contenido asociado a estos sesgos no era solo ideológico, sino también emocionalmente cargado.

En la acrofilia intragrupal, emociones como la ira y la incertidumbre aparecían con especial relevancia, a menudo relacionadas con instituciones y cuestiones morales. En la acrofilia extragrupal, la combinación emocional se desplazaba hacia el asco y la tristeza, especialmente en temas de cultura, valores e identidad. En la práctica, esto significa que el algoritmo no solo clasifica contenido por tema o ideología, sino también por intensidad emocional.

Esto ayuda a explicar por qué estos patrones resultan tan potentes. El contenido político de alta activación emocional es memorable, genera reacción y refuerza la frontera entre “nosotros” y “ellos”. En una economía de la atención, esto lo hace valioso, no necesariamente porque informe mejor, sino porque mantiene al usuario implicado.

La emoción no es un efecto secundario de la política digital; es uno de sus motores. El contenido negativo de alta intensidad emocional atrae atención, genera interacción y sostiene la actividad de las plataformas. Pero lo que es bueno para la interacción no siempre es bueno para la vida pública. Un sistema optimizado para maximizar reacciones puede terminar priorizando la indignación frente al matiz y la hostilidad frente a la comprensión.

Por qué debería importarle a cualquier usuario

Es tentador pensar que esto es un problema técnico que deben resolver las plataformas o los reguladores. No lo es. Afecta a cualquiera que obtenga información política a través de plataformas digitales, es decir, a la mayoría de nosotros.

Cuando los sistemas de recomendación amplifican sistemáticamente narrativas extremas, no solo moldean el consumo de contenido. Moldean señales de identidad social. Influyen en cómo las personas perciben lo que representa “su lado”, cómo es “el otro lado” y qué comportamientos políticos parecen normales. Con el tiempo, esto puede endurecer fronteras grupales, aumentar la hostilidad y hacer que el consenso o los puntos en común parezcan ingenuos o incluso peligrosos.

Por eso, el problema va más allá de YouTube. Los sistemas de recomendación son ya infraestructuras centrales de la atención pública. Median noticias, cultura y el sentido cotidiano de la política. Si su lógica interna recompensa el contenido más polarizador, la polarización no solo surge de la sociedad: también está siendo estructurada por la arquitectura de la exposición.

Esto tiene consecuencias para la desinformación, la confianza, el debate público y la cohesión social. Si el entorno digital recompensa sistemáticamente lo más ruidoso y antagonista, el discurso democrático se vuelve más difícil de sostener. No solo consumimos política a través de estos sistemas. Cada vez más, aprendemos qué es la política a través de ellos.

Qué debería cambiar

Si las plataformas ayudan a estructurar el conflicto ideológico, también tienen responsabilidad en reducir sus formas más dañinas. Esto no significa eliminar el desacuerdo ni imponer equilibrios artificiales, sino reconocer que la interacción no puede ser el único objetivo.

El primer paso es dejar de considerar estos sistemas como neutrales. No son espejos pasivos de las preferencias, sino actores sociotécnicos que determinan qué se vuelve visible, relevante y emocionalmente significativo.

El estudio apunta a varias posibles soluciones: modelos de recomendación que incorporen diversidad, mayor transparencia sobre por qué se recomienda cierto contenido, herramientas para que los usuarios entiendan la composición de su entorno informativo y auditorías independientes que evalúen si los sistemas amplifican contenido extremo o engañoso.

Nada de esto eliminará el desacuerdo. Ni debería hacerlo. Pero hay una diferencia entre desacuerdo y distorsión. Entre exposición a diferencias y exposición constante a su versión más extrema. Un entorno digital más saludable no nos aislaría del conflicto. Evitaría que el conflicto sea el modo por defecto de nuestra atención.

La lección de fondo

El peligro no es solo que los algoritmos nos den más de lo que ya creemos. Es que pueden enseñarnos a ver la política como una escalada constante: una versión más extrema de nuestro propio lado y una versión más caricaturizada del contrario. Cuando eso ocurre, la polarización deja de ser solo un problema de diseño. Se convierte también en un problema social.

Idioma y emoción: filtros que estructuran la política algorítmica

Si el texto de Torrens alerta sobre cómo las plataformas amplifican el conflicto político mediante la intensidad emocional, este explora qué ocurre cuando el mismo sistema de inteligencia artificial es evaluado en distintos idiomas. No se trata de dos problemas separados, sino de dos caras de un mismo fenómeno: la arquitectura de la exposición digital no es neutra. Opera con parámetros técnicos (pesos de recomendación, alineación post-entrenamiento, escalamiento de respuestas) que reordenan silenciosamente el mapa político que reciben los usuarios.

Mientras Torrens demuestra que la emoción estructura la visibilidad del desacuerdo, el estudio “Same Model, Different Politics? How Language Shapes AI Ideology” (¿Mismo modelo, distinta política? Cómo el lenguaje moldea la ideología de la IA), de Levy Yeyati, Ciappa y Onofri, de la de la Universidad Torcuato Di Tella, revela que el idioma condiciona la medición de la ideología en los modelos que cada vez más resumen, responden y median ese mismo desacuerdo.

Leerlos en conjunto obliga a abandonar la idea de que la tecnología solo “refleja” preferencias o “traduce” contenidos. La evidencia apunta a que filtra, amplifica y reordena. Y lo hace con reglas que dependen tanto del diseño de la plataforma como de la lengua con que la interrogamos.

El punto de partida: la acrofilia como mecanismo de visibilidad

Torrens y Carrasco-Farré documentan un patrón empírico robusto en YouTube: los sistemas de recomendación no solo empujan a los usuarios hacia versiones más extremas de su propio espectro (acrofilia intragrupal), sino que también los exponen desproporcionadamente a la caricatura más intensa del lado opuesto (acrofilia extragrupal).

Como ya se vio, el motor de ese desplazamiento no es ideológico en sentido abstracto; es emocional. El resultado es un entorno donde el conflicto se vuelve más nítido, más visceral y, paradójicamente, menos inteligible.

Este hallazgo es crucial porque desmonta la defensa habitual de que los algoritmos “solo reflejan lo que elegimos”. No reflejan; estructuran. Y lo hacen priorizando la intensidad sobre el matiz. Pero la pregunta que queda abierta es: si la emoción filtra la visibilidad, ¿qué otro parámetro técnico condiciona lo que el sistema devuelve cuando no solo recomienda, sino que genera?

La pieza que faltaba: el idioma como variable de medición ideológica

Aquí entra el documento de trabajo de la Escuela de Gobierno de la UTDT. Su pregunta es metodológica, pero sus implicaciones son políticas: ¿es invariante al idioma la medición de la “ideología” en grandes modelos de lenguaje? La respuesta, basada en administrar el Political Compass completo en inglés, español y francés a modelos de OpenAI, Qwen y Mistral, es contundente: NO.

Los hallazgos son matizados pero estructuralmente relevantes:

- Estabilidad cualitativa: todos los modelos se ubican en la misma zona amplia del espectro (izquierda económica, libertarismo social).

- Dependencia lingüística cuantitativa: las coordenadas exactas cambian según el idioma. GPT-3.5 se vuelve más derechista en economía al responder en español; GPT-4o, más izquierdista. En el eje social, los modelos nuevos tienden a volverse más libertarios en español.

- Magnitud relevante: en varios casos, el desplazamiento inducido por el idioma representa hasta el 80-90% de la distancia intermodelo que otros estudios interpretan como “deriva ideológica”. Cambiar de inglés a español puede alterar el ranking relativo entre modelos tanto o más que la diferencia atribuida a actualizaciones de arquitectura.

La conclusión no es que la IA “tenga opiniones distintas” en cada lengua. Es que el mapeo de sus respuestas a coordenadas ideológicas depende del contexto lingüístico de elicitación (provocar u obtener respuestas específicas mediante preguntas o estímulos diseñados para medir algo). El idioma no es un cable neutro; es un parámetro de framing (encuadre) que redistribuye probabilidades de generación, activa tradiciones discursivas distintas y modifica el instrumento de medición. Las auditorías exclusivas en inglés, por tanto, son informativas pero incompletas.

Puntos de convergencia

A primera vista, ambos textos abordan objetos distintos: uno, la dinámica de recomendación en plataformas de video; otro, la evaluación ideológica en modelos generativos. Pero comparten una tesis de fondo que transforma cómo debemos leer la mediación algorítmica:

- Variable estructural: En el estudio de Torrens y Carrasco-Farré la variable estructural clave es el diseño de recomendación combinado con la intensidad emocional del contenido. En el trabajo de Levy Yeyati es el idioma de elicitación sumado al diseño del instrumento de medición. La síntesis de ambos enfoques señala que la mediación algorítmica no es transparente: opera con filtros técnicos y contextuales que condicionan lo que vemos y cómo se mide.

- Mecanismo observable: Torrens y su colega identifican como mecanismo observable la acrofilia intra y extragrupal optimizada para maximizar el engagement: los usuarios son empujados hacia versiones más intensas de su propio espectro o expuestos a caricaturas extremas del lado opuesto. Levy Yeyati, en cambio, documenta un desplazamiento lingüístico en las coordenadas ideológicas medidas: el mismo modelo arroja posiciones distintas según responda en inglés o en español. Ambos mecanismos convergen en una conclusión compartida: la visibilidad y la medición están condicionadas por diseño, no son neutras.

- Efecto político: El efecto político que observan Torrens y Carrasco-Farré es la fragmentación del debate público producto de una exposición selectiva al contenido más extremo. Levy Yeyati y colegas identifican como efecto político una asimetría informativa entre comunidades lingüísticas: usuarios de distintos idiomas reciben encuadres ideológicos distintos del mismo sistema. La síntesis es que el conflicto político se reordena tanto por lo que se amplifica como por cómo se mide: no basta con preguntar qué muestra el algoritmo; hay que preguntar bajo qué condiciones se elicitan sus respuestas.

- Supuesto cuestionado: El estudio de Torrens cuestiona el supuesto de que “los algoritmos solo reflejan preferencias”: demuestra que estructuran la percepción del desacuerdo. El trabajo de Levy Yeyati cuestiona el supuesto de que “la ideología medida es invariante al idioma”: demuestra que el contexto lingüístico condiciona el mapeo de respuestas a coordenadas políticas. La síntesis de ambos es que la neutralidad algorítmica no es una propiedad intrínseca del sistema, sino una convención metodológica: se diseña, se mide y se reporta con sus condiciones de contorno.

Juntos, ambos textos dibujan un mapa donde la polarización no solo surge de la sociedad, sino que es estructurada por la arquitectura de la exposición. Uno muestra que la emoción no es un efecto secundario, sino un motor del mecanismo de recomendación. El otro demuestra que el idioma no es un envase transparente, sino una variable de encuadre que condiciona lo que se captura. Si queremos entender cómo la IA moldea la política, no basta con preguntar “qué piensa el modelo” o “qué muestra el algoritmo”. Hay que preguntar “bajo qué condiciones se elicitan sus respuestas, qué emociones prioriza y qué lenguas usa para medirlas”.

Implicaciones prácticas: para usuarios, reguladores y diseñadores

Esta doble advertencia tiene consecuencias concretas que trascienden lo académico:

- Para los usuarios: La próxima vez que sienta que su feed político se volvió más extremo, pregúntese si es su opinión la que cambió, o el algoritmo el que está amplificando ciertas versiones del desacuerdo. Y si usa un chatbot para informarse sobre política, recuerde que sus respuestas pueden variar según el idioma en que le pregunte -no por manipulación deliberada, sino por arquitectura de entrenamiento y calibración de instrumentos. La alfabetización digital hoy requiere entender que cada interacción está mediada por filtros invisibles.

- Para los reguladores: Si se exige transparencia en la alineación política de modelos desplegados en múltiples lenguas, no basta con pedir un score por idioma. Hay que requerir desglose de ítems sensibles, reporte de desplazamientos cross-language y auditorías que consideren la emoción como variable de diseño. La gobernanza de la IA no puede ser monolingüe ni agnóstica a la intensidad afectiva. Los estándares de evaluación deben incluir métricas de volatilidad lingüística y calibración emocional de recomendaciones.

- Para diseñadores de sistemas: La neutralidad no se declara; se diseña. Incorporar diversidad en los modelos de recomendación, documentar qué lenguas fueron incluidas en procesos de alineación, y evitar extrapolaciones universales desde benchmarks anglófonos (tests hechos en inglés) no son gestos cosméticos. Son condiciones mínimas para que la evaluación sea comparable y el despliegue, responsable. Un sistema que optimiza solo para engagement o que se audita solo en inglés no es neutro; es incompleto por diseño.

Hacia una lectura crítica de la mediación algorítmica

La pregunta “¿tiene la IA ideología?” seguirá circulando en redacciones y foros. Pero estos dos estudios invitan a reformularla. No se trata de buscar una brújula política oculta en los pesos del modelo. Se trata de reconocer que la medición ideológica es inherentemente contextual, y que la exposición política está estructurada por decisiones técnicas, comerciales y organizativas.

En un mundo donde millones aprenden qué es la política a través de sistemas diseñados para maximizar la interacción, esa distinción no es académica. Es democrática.

La próxima vez que lea que un chatbot “viró a la izquierda” o que una plataforma “radicaliza” a sus usuarios, pregunte: ¿en qué idioma se midió? ¿qué emociones está amplificando? ¿y qué versiones del desacuerdo estamos siendo entrenados para reconocer como “normales”?

Porque en la era de la IA multilingüe y emocionalmente optimizada, la política no está solo en el contenido. Está en el filtro que lo hace visible. Y mientras no ajustemos ese marco de lectura, seguiremos midiendo fragmentos de un reflejo, convencidos de que estamos leyendo un pensamiento.