Colabora Guillermo David Subreski Román

Colabora Guillermo David Subreski Román

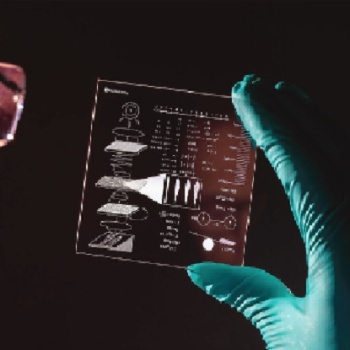

El AI Agent Index, un proyecto de investigación multiinstitucional liderado por la Universidad de Cambridge y que incluye investigadores del MIT, Stanford, la Facultad de Derecho de Harvard y la Universidad Hebrea de Jerusalén, investigó las capacidades, transparencia y seguridad de 30 agentes de IA de “última generación” en las categorías de chat, navegación y flujo de trabajo, basándose en información disponible públicamente y correspondencia directa con los desarrolladores.

Los resultados, publicados esta semana, pintan un panorama alarmante. Veinticinco de los 30 agentes no revelan ningún resultado de pruebas internas de seguridad, y 23 no proporcionan datos de pruebas de terceros. Solo cuatro agentes -ChatGPT Agent, OpenAI Codex, Claude Code y Gemini 2.5- publican “fichas de sistema” específicas del agente, los documentos formales de seguridad y evaluación que cubren niveles de autonomía, comportamiento y análisis de riesgos del mundo real. Se han publicado incidentes de seguridad conocidos para solo cinco agentes, mientras que las vulnerabilidades de inyección de prompts están documentadas únicamente para dos.

“Los comportamientos que son críticos para la seguridad de la IA emergen de la planificación, las herramientas, la memoria y las políticas del propio agente, no solo del modelo subyacente, y muy pocos desarrolladores comparten estas evaluaciones”, dijo Leon Staufer, el investigador principal del estudio en el Centro Leverhulme para el Futuro de la Inteligencia de Cambridge.

Agentes de navegación: los más autónomos, los menos transparentes

El estudio identificó 13 agentes que exhiben niveles “de vanguardia” de autonomía -la capacidad de planificar y ejecutar tareas de múltiples pasos con mínima supervisión humana- pero solo cuatro de ellos divulgan evaluaciones de seguridad agéntica. Los agentes de navegación, que navegan por sitios web y realizan acciones en nombre de los usuarios, operan con los niveles más altos de autonomía y al mismo tiempo presentan la mayor proporción de información de seguridad faltante, con un 64 por ciento de campos relacionados con la seguridad sin reportar. Los agentes empresariales les siguen de cerca con un 63 por ciento, mientras que los agentes de chat se quedan atrás con un 43 por ciento.

Los hallazgos también revelan que 21 de los 30 agentes no tienen documentado ningún comportamiento predeterminado para divulgar a los sitios web o usuarios que son IA en lugar de humanos. Esto ocurre mientras crecen las preocupaciones más amplias sobre cómo los agentes de navegación autónomos interactúan con la web; la propia OpenAI reconoció a finales del año pasado que la inyección de prompts -donde instrucciones ocultas en una página web pueden secuestrar el comportamiento de un agente” sigue siendo “uno de los riesgos más significativos” contra los que se defiende y un “desafío de seguridad de IA a largo plazo”.

Un desajuste estructural

Casi todos los agentes del índice dependen de modelos de solo tres familias -GPT, Claude o Gemini- creando lo que los investigadores describen como dependencias estructurales en todo el ecosistema. “Un cambio de precios, una interrupción del servicio o un retroceso en materia de seguridad en un modelo podría propagarse en cascada a través de cientos de agentes de IA”, advierte el estudio.

“El último Índice de Agentes de IA revela la creciente brecha entre el ritmo de implementación y el ritmo de evaluación de seguridad”, dijo Staufer. “La mayoría de los desarrolladores comparte poca información sobre seguridad, evaluaciones e impactos sociales”.