Guillermo David Subreski Román

Guillermo David Subreski Román

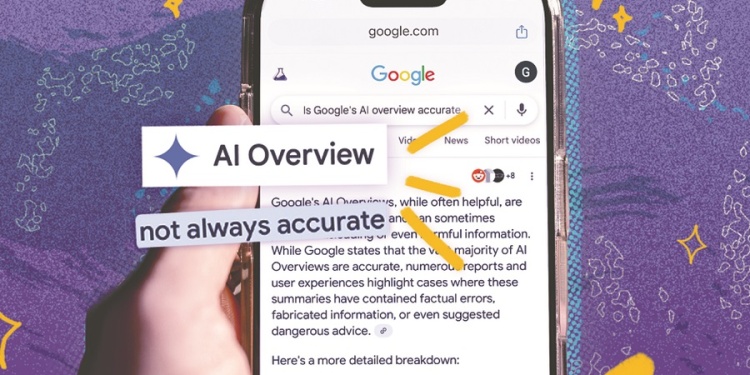

Los resúmenes de búsqueda generados por la IA de Google responden correctamente a las preguntas de índole factual aproximadamente el 91% de las veces, una cifra que podría parecer tranquilizadora hasta que se analiza lo que implica a gran escala. Con Google procesando más de 5 billones de búsquedas al año, incluso una tasa de error de un solo dígito se traduce en decenas de millones de respuestas incorrectas llegando a los usuarios cada hora, según un análisis publicado el martes por The New York Times.

El estudio, realizado por la startup de IA Oumi por encargo del Times, evaluó los Resúmenes de IA de Google –los resúmenes generados automáticamente que aparecen por encima de los resultados de búsqueda tradicionales- y concluyó que la precisión mejoró después de que Google actualizara su modelo de Gemini 2 a Gemini 3. Con Gemini 2, los resúmenes eran imprecisos aproximadamente el 15% de las veces; con Gemini 3, esa cifra se redujo a alrededor del 9%.

Un problema creciente con las fuentes

Quizás más preocupante que los errores directos es lo que el estudio reveló sobre el uso de fuentes. Según el análisis, el 56 por ciento de las respuestas correctas de Gemini 3 carecían de respaldo suficiente, lo que significa que los sitios web citados junto al texto generado por IA no sustentaban plenamente la información proporcionada. Esta cifra representa un aumento considerable frente al 37 por ciento registrado con el modelo anterior, Gemini 2, lo que sugiere que, a medida que la IA de Google ha ganado en precisión, ha empeorado simultáneamente a la hora de mostrar a los usuarios de dónde provienen esas respuestas.

Google responde a las críticas

Google rebatió los hallazgos, calificando el estudio de defectuoso y argumentando que se basó en un benchmark que no refleja cómo las personas realmente usan la búsqueda. La empresa ya había rechazado análisis similares anteriormente; cuando la firma de análisis de datos Growtika publicó una investigación sobre el impacto de AI Overviews en el tráfico web a principios de este año, un portavoz de Google tachó ese estudio de “fundamentalmente defectuoso” también.

La tensión entre la confianza declarada de Google en sus AI Overviews y los análisis externos que cuestionan su fiabilidad ha sido un tema recurrente. The Guardian informó en enero que expertos en salud encontraron orientación engañosa en algunas respuestas de AI Overviews, lo que llevó a Google a eliminar ciertos resúmenes médicos. Google ha mantenido que “la gran mayoría” de los AI Overviews son “precisos y útiles”, reconociendo al mismo tiempo que “continuamente” realiza mejoras de calidad.

Los hallazgos de Oumi llegan en un momento en que la búsqueda impulsada por IA se vuelve inevitable. Los AI Overviews aparecen ahora en casi la mitad de todas las búsquedas rastreadas en Google, frente a aproximadamente el 31 por ciento hace un año, según datos de BrightEdge. Como descubrió el año pasado un equipo de investigación de la Universidad de Columbia, los motores de búsqueda con IA de toda la industria respondieron incorrectamente a más del 60 por ciento de las consultas al citar artículos de noticias, y rara vez indicaban incertidumbre.

De más de 5.000 fuentes citadas por los Resúmenes de IA durante el análisis, Oumi -que desarrolló HallOumi, una herramienta de código abierto para detectar alucinaciones- descubrió que el sistema de Google recurre a una mezcla poco fiable de fuentes, desde medios consolidados hasta publicaciones de Facebook. Cuando los resúmenes eran inexactos, citaban Facebook con mayor frecuencia que cuando eran correctos.