Cada vez más personas recurren a ChatGPT como un espacio en el que expresar sus preocupaciones emocionales y personales. En un contexto donde la Inteligencia Artificial (IA) avanza rápidamente y comienza a ocupar un lugar cada vez más importante en distintos aspectos de la vida cotidiana, la IA se está posicionando también, de forma inesperada, en el terreno de la salud mental.

El uso de chatbots para abordar cuestiones tan delicadas como la ansiedad, la soledad o las inseguridades plantea nuevas interrogantes sobre sus límites, beneficios y riesgos en el acompañamiento psicológico.

Emilse Lunge, licenciada en Psicología, compartió su mirada sobre el tema en diálogo con PRIMERA EDICIÓN.

Aspectos que se dejan de lado

Consultada sobre el creciente uso de herramientas como ChatGPT para consultas psicológicas, especialmente entre jóvenes, Lunge sostuvo que “el uso de la inteligencia artificial es muy interesante y es muy útil porque puede ayudarnos, puede orientarnos en un montón de cosas, un montón de aspectos de la vida en general”.

Sin embargo, remarcó que “lo importante siempre es recordar que justamente es una inteligencia artificial, que no es una persona la que te está escuchando o leyendo ahí, sino que es una máquina. Entonces, hay un montón de cosas que tiene el ser humano que se pierden”.

En este sentido, advirtió que “se pierde la capacidad de sentir, de empatizar, de reconocer el dolor del otro”, cuestiones fundamentales en el tratamiento psicológico. “Una máquina no puede reconocer el dolor”, remarcó.

“No deja de ser una máquina”

Lunge comentó que ella misma experimentó interactuar con IA para observar su funcionamiento.

“Todos por ahí hemos caído en ver de qué se trata esto. Por ahí sí te da respuestas que son asertivas y que tienen un tono más cálido, y vos decís ‘pareciera que estoy hablando con un humano’. Pero en realidad no deja de ser una máquina”, afirmó.

También explicó que existen elementos humanos que la IA no puede interpretar: “La interpretación de lo humano, del sentimiento, de la postura, del tono con el que se dice tal o cual mensaje, se pierde porque estas son cosas que la inteligencia no puede interpretar”, sostuvo.

Riesgos de diagnósticos erróneos

Respecto a las posibles consecuencias de confiar en diagnósticos brindados por IA, Lunge fue contundente: “Claramente tiene una repercusión negativa”, aseguró.

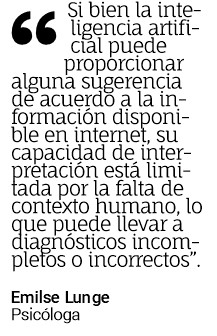

“Si bien la inteligencia artificial puede proporcionar alguna sugerencia de acuerdo a la información disponible en internet, su capacidad de interpretación está limitada por la falta de contexto humano, lo que puede llevar a diagnósticos incompletos o incorrectos”.

“Es como los de la vieja escuela, por ahí nos diagnosticábamos con Google, que poníamos ‘tengo tal síntoma’ y directamente terminabas con una enfermedad terminal y en realidad no era para tanto. Bueno, lo mismo está pasando ahora con la inteligencia artificial”, remarcó.

“Lo más probable es que te termine diciendo que tenés depresión o ansiedad, y en realidad a veces no es un trastorno, sino momentos que está atravesando la persona. Esto sí podría reconocerlo un psicólogo o un psiquiatra, y no una inteligencia artificial”, subrayó.

La importancia del vínculo humano

Consultada sobre la relación que se construye entre psicólogo y paciente, Lunge destacó que el vínculo humano es irreemplazable:

“Inclusive más allá de que la inteligencia tenga una memoria, muchas veces no quedan registradas ciertas cosas. La inteligencia las pasa por alto, cosa que el psicólogo no lo haría”, explicó.

Además, remarcó que, aunque la terapia virtual se popularizó, no se pierde el componente humano: “Se puede percibir el tono de la voz, la imagen física, la postura que tiene el paciente. Muchas veces lo que uno dice no sale únicamente por las palabras, sino también lo corporal lo está mostrando. Y esto una inteligencia artificial no lo puede ver”, sostuvo.

“La inteligencia artificial no es tan completa ni tan segura como sería una consulta con una persona de carne y hueso”, resaltó.

Para Lunge, si bien la IA es una herramienta muy útil, en áreas sensibles como la salud mental el rol humano sigue siendo fundamental: “No la estoy demonizando, pero en ámbitos tan particulares que tienen que ver con lo humanamente propio, me parece que también hay que seguir dándole lugar al ser humano y no tanto a la inteligencia artificial”, planteó.

¿Por qué los jóvenes consultan más a la IA?

Respecto a la elección de los jóvenes de consultar a una IA antes que a un profesional de salud mental, Lunge analizó:

“Puede deberse a muchos factores. Principalmente la cuestión económica, porque la inteligencia artificial está ahí, solo necesitás acceso a internet y un dispositivo”, indicó.

También mencionó que influye la inmediatez en la respuesta: “Te pasa algo y buscás acá. Tenés en tus manos alguien que te va a dar una respuesta más amable que no tener ninguna respuesta”, observó.

Sin embargo, advirtió que “la IA tiende a dar respuestas acorde a lo que vos querés escuchar, no a lo que necesitás escuchar”, y aclaró que el rol del psicólogo es precisamente “dar una respuesta acorde a lo que se necesita, aunque no siempre sea lo que se quiere oír”.

“No siempre la respuesta de internet es la correcta”

Finalmente, Lunge insistió en la importancia de ser cautelosos frente a diagnósticos realizados por medios digitales: “No siempre dan la respuesta exacta al malestar que estamos teniendo en ese momento”, concluyó.